Googlebotの仕組みが公式解説された。クロールされやすいサイトの条件とは

この記事のポイント

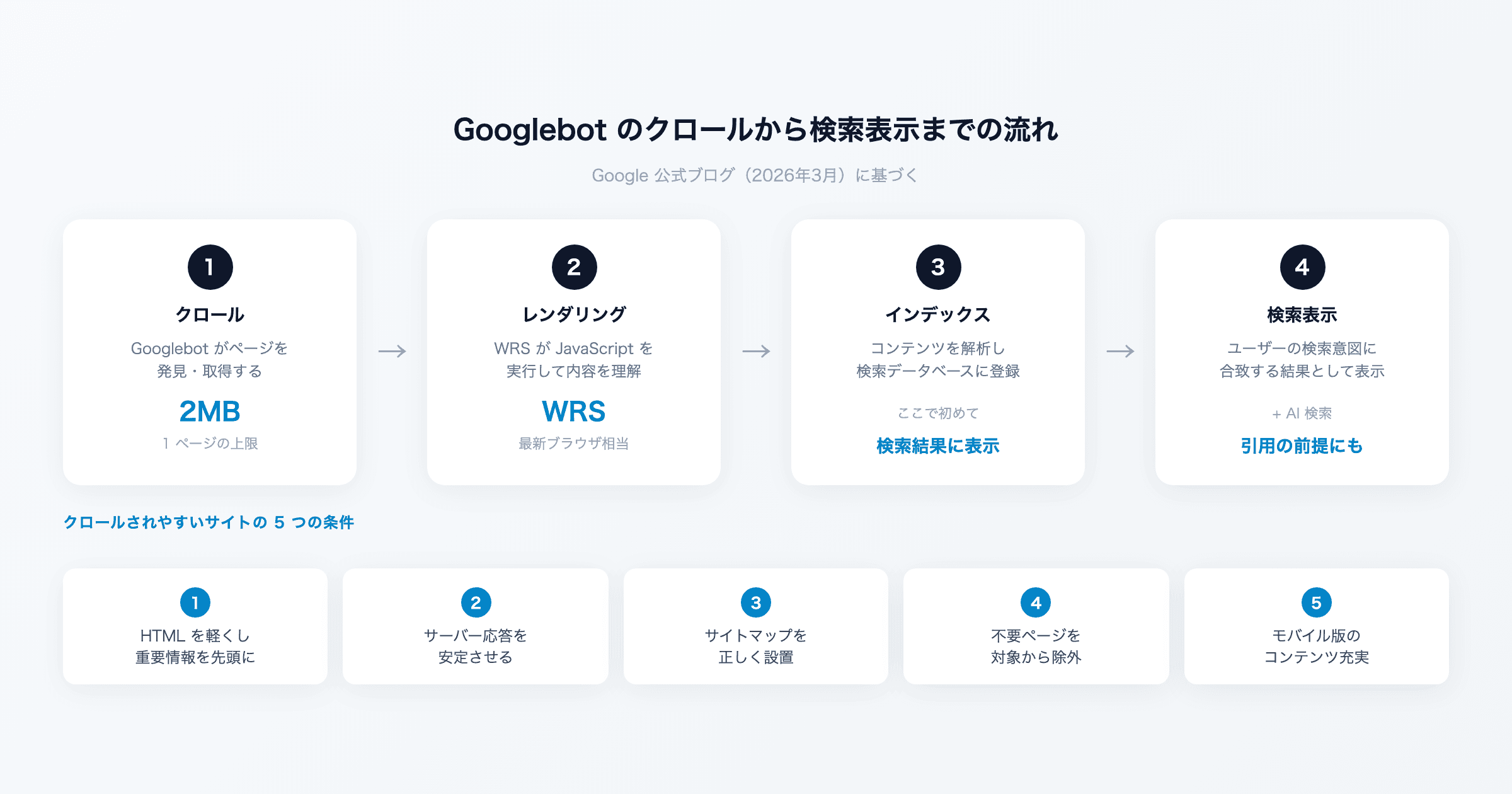

2026年3月にGoogleがGooglebotの内部構造を公式に解説しました。1ページ2MBまでしか読まない制限、Web Rendering Serviceの処理フロー、クローラーIPレンジの配置変更が主な発表内容です。一般的なサイトは2MB制限の心配は不要ですが、Search Consoleのクロール統計情報でクロール状況を定期確認することが重要です。

Googlebotのクロールとは、Google検索がWebページの内容を収集・解析するために行う自動巡回の仕組みのことです。2026年3月、Googleが公式ブログでGooglebotの内部構造を初めて詳しく解説しました。この記事では、公式発表の要点を整理し、マーケティング担当者が自社サイトのクロール状況を確認するための方法を紹介します。

Googleが「Googlebotの中身」を初めて詳しく公開した

Googleはこれまで、Googlebotの技術的な内部構造について限定的な情報しか公開していませんでした。2026年3月の公式ブログ記事で、その仕組みが体系的に解説された意義は大きいと言えます。

Googlebotは1台のロボットではなく、共有インフラの一部だった

多くの人が「Googlebot = 1台の専用ロボット」というイメージを持っているかもしれません。しかし公式の解説によると、Googlebot は Google 内部の集中型クロールプラットフォームの 1 ユーザーに過ぎません。

このプラットフォームは、Google Shopping、AdSense、Google ニュースなど数十のサービスが共有しています。つまり、Googlebotが単独でWebを巡回しているのではなく、Google全体のインフラの一部として動いているということです。

この事実は、クロールの優先順位がGoogle側のリソース配分に左右されることを意味します。自社サイトがいつ、どのくらいの頻度でクロールされるかは、サイト側だけでなくGoogle側の都合にも依存しています。

1ページあたり2MBまでしか読まれない。その根拠と背景

今回の公式発表で注目を集めたのが「1 ページあたり最大 2MB」という数値です。Googlebot は、HTTP ヘッダーを含む圧縮前のサイズで 2MB までしかフェッチしません。2MB を超えた部分は、フェッチもレンダリングもインデックスもされません。完全に無視されます。

ただし、一般的なWebページのHTMLは数百KB程度です。通常の企業サイトやブログ記事であれば、この制限に引っかかることはまずありません。

注意が必要なのは、EC サイトの商品一覧ページや、大量のインライン SVG を含むページなど、HTML が肥大化しやすいケースです。PDF については 64MB まで対応しているため、PDF 資料を公開しているサイトも心配は不要です。

2MB の制限は「圧縮前」のサイズです。gzip や Brotli で圧縮して配信している場合でも、解凍後のサイズが 2MB を超えていると超過分は読まれません。

クロールされないページは、存在しないのと同じ

検索結果に表示されるためには、まずGooglebotにクロールされ、次にインデックスされる必要があります。どれだけ良い記事を書いても、クロールされなければ検索ユーザーの目に触れることはありません。

記事を公開しても検索に出ない。その原因はクロールにあるかもしれない

「記事を公開したのに、いつまでたっても検索結果に出てこない」。こうした相談はマーケティング担当者からよく寄せられます。原因はコンテンツの品質だけではありません。そもそもGooglebotがそのページにたどり着けていない可能性があります。

よくある原因として、サイト内部のリンク構造が深すぎてGooglebotが到達しにくい、サーバーの応答が遅くてクロールが途中で打ち切られる、といったケースがあります。コンテンツの質を改善する前に、まずクロールされているかどうかを確認する方が先です。

AI 検索に自社コンテンツを引用してもらうためにも、まずGoogle検索にインデックスされていることが前提になります。AI検索に引用されるための戦略を考える場合でも、クロールとインデックスは最初のステップです。

クロールバジェットとは何か。なぜ大規模サイトほど影響が大きいのか

クロールバジェットとは、Googlebotが一定期間内にサイトをクロールできるページ数の上限のことです。すべてのサイトに無制限のクロールリソースが割り当てられているわけではありません。

数百ページ程度の企業サイトやオウンドメディアであれば、クロールバジェットを意識する必要はほとんどありません。Googlebotは十分な頻度で全ページを巡回できます。

問題になるのは、数万ページ以上を持つ大規模サイトです。EC サイト、不動産ポータル、求人サイトなどが該当します。こうしたサイトでは、重要でないページにクロールリソースが消費され、本当にインデックスしてほしいページが後回しにされることがあります。

| サイト規模 | ページ数の目安 | クロールバジェットの影響 |

|---|---|---|

| 小規模 | 数百ページ以下 | ほぼ影響なし |

| 中規模 | 数千ページ | 通常は問題なし |

| 大規模 | 数万ページ以上 | 最適化が必要 |

自社サイトがGooglebotにクロールされやすくなる5つの条件

今回の公式発表と従来のベストプラクティスを踏まえて、Googlebotがクロールしやすいサイトの条件を整理します。技術的な実装の詳細ではなく、マーケティング担当者が「何を気にすべきか」という考え方に絞ってまとめます。

HTMLを軽くする。重要な情報を先頭に置く

2MB制限のことを考えると、HTMLは軽いに越したことはありません。ページの先頭に重要なコンテンツを配置し、装飾用のコードや繰り返しの多い要素は後方に回す設計が有効です。

特に、商品一覧ページで数百件の商品情報を1ページに詰め込んでいる場合は注意が必要です。ページネーションで分割するか、主要な情報だけをHTMLに含める構成を検討してください。

サーバーの応答速度を安定させる

Googlebotがページを取得しようとした際に、サーバーが遅延したりエラーを返したりすると、クロールの効率が下がります。一時的なサーバーダウンであっても、Googlebotがそのタイミングで訪問すればクロールは失敗です。

安定した応答速度を維持することは、ユーザー体験の向上だけでなく、クロール効率の面でも重要です。503 エラーが頻発するサイトは、Googlebotのクロール頻度が下がる可能性があります。

サイトマップを正しく設置し、更新を伝える

サイトマップは、Googlebotにサイト内のページ構成を伝えるための仕組みです。特に新しいページを公開した際に、サイトマップを通じてGooglebotに存在を知らせることで、クロールまでの時間を短縮できます。

サイトマップの送信状態は Search Console で確認できます。送信しただけで放置していると、古い情報のまま更新されていないケースもあるため、定期的な確認が必要です。

不要なページをクロール対象から外す

検索結果に表示する必要のないページ(管理画面、検索結果ページ、テスト環境など)がクロール対象に含まれていると、限られたクロールリソースが無駄に消費されます。

不要なページを適切に制御することで、Googlebotのリソースを重要なページに集中させることができます。特に大規模サイトでは、この最適化の効果が顕著に表れます。

モバイル版のコンテンツを充実させる

Googleはモバイルファーストインデックスを採用しており、Googlebotはスマートフォン版のページを優先的にクロールします。デスクトップ版にしかコンテンツがない場合、そのコンテンツはインデックスされない可能性があります。

モバイル版とデスクトップ版でコンテンツに差がないか、定期的に確認することが重要です。

2026年3月の公式発表で変わったこと

今回の公式発表で新たに明確になった点を整理します。

2MB制限の正しい理解。一般的なサイトは心配不要

2MB制限が話題になりましたが、この数値が新しく設定されたわけではありません。以前から存在していた制限が、今回の公式発表で初めて明確に文書化されたものです。

一般的な Web ページの HTML サイズは数十 KB から数百 KB 程度です。画像や動画はHTMLサイズには含まれません(別リクエストで取得されるため)。そのため、通常の記事ページやサービスページで2MBを超えることはまずありません。

自社サイトの HTML サイズを確認するには、ブラウザの開発者ツール(DevTools)でネットワークタブを開き、HTML ドキュメントのサイズを確認する方法が簡単です。

クローラーIPレンジの配置変更。ファイアウォール設定への影響

Googlebotが使用するIPアドレスの範囲を公開しているファイルの配置場所が変更されました。6ヶ月の移行期間が設けられています。

この変更は、ファイアウォールやアクセス制御でGooglebotのIPレンジを参照している場合に影響があります。CDN や WAF(Web アプリケーションファイアウォール)の設定で Googlebot を許可リストに入れている場合は、新しいファイルの場所に更新する必要があります。

一般的な企業サイトでGooglebotのIPを個別に管理しているケースは少ないため、多くのサイトでは対応不要です。インフラ担当者がいる場合は、念のため確認を依頼しておくとよいでしょう。

Web Rendering Serviceの進化。JavaScriptサイトも正しく処理される

GoogleのWeb Rendering Service(WRS)は、JavaScriptを実行してページの最終的な表示状態を理解するシステムです。今回の公式発表で、WRSが最新のブラウザと同等のJavaScript処理能力を持つことが改めて確認されました。

React、Vue、Next.js などのフレームワークで構築された SPA(シングルページアプリケーション)も、WRS によって正しく処理されます。ただし、レンダリングにはフェッチとは別のステップが必要なため、サーバーサイドレンダリング(SSR)で最初から HTML にコンテンツを含めておく方が、クロールからインデックスまでの時間は短くなります。

マーケ担当者が今日からできる3つの確認作業

ここまでの内容を踏まえて、マーケティング担当者がすぐに実行できる確認作業を3つ紹介します。

Search Consoleの「クロールの統計情報」を確認する

Search Consoleの「設定」メニューから「クロールの統計情報」を開くと、Googlebotがサイトを訪問した頻度、ダウンロードしたデータ量、応答時間の推移などが確認できます。

確認すべきポイントは以下のとおりです。

- クロールリクエスト数が極端に少なくなっていないか

- サーバーの応答時間が安定しているか

- クロールエラー(5xx エラーなど)が発生していないか

クロールリクエスト数が急減している場合は、サーバー側に問題がある可能性があります。Search Consoleのデータ変動の見方も参考にしてください。

ページのHTMLサイズを確認する方法

自社サイトの主要なページについて、HTML サイズが 2MB を超えていないか確認します。確認手順は以下のとおりです。

- ブラウザでページを開く

- 開発者ツール(F12キー)を開く

- 「ネットワーク」タブを選択する

- ページをリロードする

- ドキュメント(HTMLファイル)のサイズを確認する

ほとんどのページは数百 KB 以下に収まるはずです。もし 1MB を超えているページがあれば、HTML の構造を見直すことを検討してください。

画像や CSS、JavaScript ファイルのサイズは 2MB 制限とは別です。2MB の制限は HTML ドキュメント自体(HTTP ヘッダー含む、圧縮前)に適用されます。

サイトマップの送信状態を確認する

Search Consoleの「サイトマップ」メニューから、サイトマップの送信状態を確認します。

- サイトマップが正常に読み込まれているか

- 送信したURLのうち、インデックスされている割合はどの程度か

- 最終読み取り日が最近の日付になっているか

サイトマップが長期間更新されていない場合や、エラーが発生している場合は、対応が必要です。新しい記事を公開した後にサイトマップが自動更新される仕組みになっているかも確認しておきましょう。

まとめ

2026年3月のGoogleの公式発表により、Googlebotの内部構造がこれまで以上に明確になりました。マーケティング担当者が押さえるべきポイントを振り返ります。

- Googlebotは単独のロボットではなく、Google内部の共有インフラの一部として動いている。クロールの優先順位はGoogle側のリソース配分にも左右される

- 1ページ2MBの制限は存在するが、一般的なWebページでは心配不要。ECサイトの大量商品一覧ページなど、HTMLが肥大化しやすいケースのみ注意する

- クロールされなければ検索結果にも出ず、AI検索に引用されることもない。まずはSearch Consoleのクロール統計情報で自社サイトの状況を把握することが最初のステップになる

- コアアップデート後の順位変動に対応する際も、クロールとインデックスの状態を確認することが基本になる

クロールの仕組みを正しく理解することで、「記事を公開したのに検索に出ない」という問題の原因を切り分けやすくなります。spotyou で作成した記事も、クロールされてインデックスされて初めて検索流入やAI検索での引用につながります。まずは今日、Search Consoleのクロール統計情報を確認することから始めてみてください。

よくある質問

Googlebotとは何ですか?

Googlebot は Google 検索が Web ページの情報を収集するためのクローラーです。Google 内部の集中型クロールプラットフォームの 1 ユーザーであり、Google Shopping や AdSense など数十のサービスが同じインフラを共有しています。

Googlebotの2MB制限とは何ですか?自社サイトに影響がありますか?

Googlebot は 1 ページあたり最大 2MB(HTTP ヘッダー含む、圧縮前)までしか読み込みません。ただし一般的な Web ページの HTML は数百 KB 程度なので、ほとんどのサイトでは問題になりません。商品一覧ページなど HTML が肥大化しやすいページは確認が必要です。

自社サイトがGooglebotにクロールされているか確認する方法は?

Google Search Consoleの「設定」から「クロールの統計情報」を開くと、Googlebotがサイトを訪問した頻度やレスポンス状況を確認できます。

クロールバジェットとは何ですか?

Googlebotが一定期間内にサイトをクロールできるページ数の上限です。数百ページ程度の小規模サイトでは通常気にする必要はありません。数万ページ以上の大規模サイトで影響が出やすくなります。

JavaScriptで表示されるコンテンツはGooglebotに読まれますか?

はい。GoogleのWeb Rendering Service(WRS)がJavaScriptを実行し、最終的なページの状態を理解します。ただし重要な情報はHTMLに直接含めるのが確実です。